带来高效便利的生成式人工智能,已然成为不法分子用来牟利的工具,AI 换脸诈骗、AI 造谣等这类乱象频繁发生,进而引发了社会的广泛担忧。国家网信办等七个部门,在日前联合出台了《生成式人工智能服务管理暂行办法》,以重拳出击的方式,力求为这股技术浪潮划定安全红线。

滥用乱象触目惊心

AI正深度融入社会,从自动驾驶领域到医疗诊断范畴,皆是如此。然而,技术被恶意利用的风险陡然间上升了。近期,内蒙古包头警方所披露的AI换脸诈骗案让人十分震惊,受害者在视频确认“好友”身份之后,十分钟之内被骗走极为巨额的430万元。这类案件清楚表明,深度伪造技术已然从概念变成了现实犯罪行为,此给公众财产安全构成了直接性的威胁。

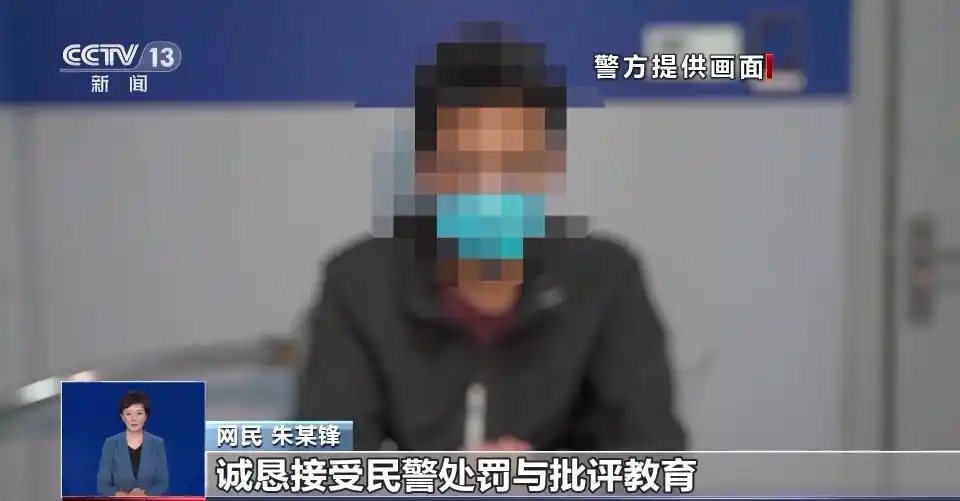

于信息传播范畴之内,生成式AI同样摇身变为谣言滋生的温床,江苏盐城有网民朱某锋,其目的在于博取众人眼球以及平台所发放的奖金,借助GPT去编造“女大学生遇袭”这一虚假新闻,并且为之配上图片而后进行传播,这般具备低成本、高效率特性的造谣手段,极其容易引发社会层面的恐慌情绪,对公共秩序予以扰乱,彰显出技术被滥用时所存在的严重危害。

新规出台正逢其时

面对技术应用所伴生出来的风险,监管务必要跟上创新的脚步步伐。《生成式人工智能服务管理暂行办法》在2023年8月15日正式开始施行,这标志着我国对于生成式AI的监管进入到了有法可依的全新阶段。该办法的出台并不是意在去限制其发展,而是旨在推动促进这项技术能够健康地发展以及规范地应用。

国家网信办相关负责人明确表明,出台《办法》的核心目的是维护国家安全与社会公共利益,与此同时保护公民、法人及其他组织的合法权益,这表明监管会兼顾创新激励以及风险防控,于安全底线上促使产业向前发展,回应了公众对于AI治理的急切期待。

划定清晰责任边界

《办法》给服务提供者设定了清晰的责任与义务,其中一项是规定提供者要对生成内容担责,采取有效举措避免生成非法信息,这表明诸如GPT这类工具的运营方,定要强化内容过滤以及审核机制,从源头削减有害信息的产出。

《办法》着重指出,不得借助算法去开展危害国家安全、损害他人合法权益的活动,这直接是针对AI换脸诈骗、深度伪造诽谤等行径,为执法部门打击这类犯罪给予了强有力的法律依据,并敦促技术开发者以及使用者严格遵守法律与伦理底线。

聚焦数据安全与隐私

那种依靠着海量数据来进行训练以及运行的生成式AI,其中很可会含有大量的个人敏感信息,《办法》针对这个着重进行强调,要求服务提供者在处理个人信息的时候应当取得个人的同意,并且要去遵守相关的法律法规,这样做是在于防止数据被滥用,以此保护公民的隐私权让其不会受到侵害。

于数据来源这块儿,《办法》倡导运用合法合规的数据资源去开展训练,且尊重知识产权。这对构建健康的数据生态有益,能避免因使用侵权或者非法数据而引发的法律风险,给AI产业的可持续发展筑牢稳固基础。

建立协同治理体系

人工智能治理并非单一部门的职责所归 ,《办法》是由网信办联合发改委 、教育部 、科技部等七个部门共同予以公布的 ,这展现出了多部门协同治理的思路。这种跨部门的协作能够在技术研发 、应用推广 、行业监管等各个环节实现更为全面的覆盖。

治理体系同样着重社会共同治理,《办法》引领行业组织强化自我约束,激励公众展开监督,比如说,针对朱某锋这类造谣之人的查处,便离不开群众的检举以及平台的协作,多方一同参与会形成治理方面的合力,能更高效地抑制乱象。

推动产业健康发展

规范的最终目标旨在达成更为优质的发展,《办法》于划定红线之际,还明确宣称鼓励生成式AI技术在各个行业的创新运用,清晰的规则能够削减市场不确定性,赋予合规企业稳定的发展预期,吸引更多资源投入正向研发。

从长远的视角出发,有效的监管乃是赢得公众信任的关键。一旦用户坚信技术应用是安全并无虞、可靠且值得信赖的,电商直播、智能客服、AI辅助诊疗像这样的应用才能够切实地普及开来,从而释放出其提升效率、改善生活的具有强大力量的巨大潜力。严密而且严格的规矩呀,正是为了迈向更为广阔、更加宽广无所拘束的天地呢。

当面对那把被称作生成式AI的“双刃剑”时,你觉得在去享受它所带来的便利之际,个人究竟该以怎样的方式去提高警惕,从而防范潜藏着的风险呢?欢迎来到评论区去分享你内心的看法,要是你认为本文是具有实用价值的,请点赞给予支持且将其转发给更多的朋友。